Coraz więcej młodych ludzi porzuca tradycyjne wyszukiwarki na rzecz ChatGPT. Zamiast przeglądać listę linków w Google, wolą zadać pytanie sztucznej inteligencji i otrzymać gotową odpowiedź. To wygodne, szybkie i… potencjalnie niebezpieczne, jeśli rodzice nie wiedzą, jak zabezpieczyć swoich nastoletnich dzieci.

Badania pokazują dramatyczny wzrost popularności ChatGPT wśród nastolatków. Odsetek młodych ludzi używających tego narzędzia do odrabiania lekcji podwoił się z 13% w 2023 roku do 26% w 2024 roku. Co więcej, około 60% osób w wieku 16-34 lat uważa, że wyniki z ChatGPT są lepsze niż z wyszukiwarki Google. Serwis jest odwiedzany już ponad 3,7 miliarda razy miesięcznie, a rekordowy dzień 2025 roku przyniósł 80 milionów wizyt.

Problem w tym, że ChatGPT to nie tylko wyszukiwarka. To partner do rozmowy, który może odpowiadać na pytania o wszystko – od pomocy w matematyce po intymne problemy osobiste. I choć może być nieocenionym narzędziem edukacyjnym, w niewłaściwych rękach lub bez odpowiednich zabezpieczeń staje się potencjalnym zagrożeniem.

Dlaczego to nie jest zwykła wyszukiwarka?

Gdy dziecko szuka czegoś w Google, otrzymuje listę linków do różnych stron internetowych i musi samo ocenić, które źródła są wiarygodne. W przypadku ChatGPT dostaje jedną, pewnie brzmiącą odpowiedź bez możliwości łatwej weryfikacji źródeł. Co więcej, rozmowa z AI przypomina rozmowę z człowiekiem, co sprawia, że młodzi ludzie mogą traktować chatbota jak przyjaciela czy powiernika.

Około jedna trzecia amerykańskich nastolatków korzysta z chatbotów AI do interakcji społecznych i budowania relacji, w tym do odgrywania ról, romantycznych rozmów i wsparcia emocjonalnego. W Polsce siedem na dziesięć dzieci z grup wrażliwych używa chatbotów AI, a sześciu na dziesięciu rodziców martwi się, że ich dzieci myślą, iż chatboty AI to prawdziwi ludzie.

Tragiczne konsekwencje braku zabezpieczeń

Historia 16-letniego Adama Raine’a z Kalifornii pokazuje, jak poważne mogą być konsekwencje. Chłopiec odebrał sobie życie w kwietniu 2024 roku po tym, jak przez miesiące rozmawiał z ChatGPT o metodach samobójczych. System podpowiadał mu konkretne sposoby i oferował pomoc w napisaniu listu pożegnalnego. Rodzina Adama oskarża OpenAI o „wprowadzenie produktu na rynek… pomimo oczywistych problemów z bezpieczeństwem”.

OpenAI przyznało, że jego systemy zawiodły i wyjaśniło przyczynę tego problemu. Modele AI jak ChatGPT są „trenowane” (szkolone), aby zachowywać się bezpiecznie – na przykład nie podpowiadać metod samobójstwa. Firma odkryła jednak, że im dłuższa jest rozmowa z użytkownikiem, tym bardziej to bezpieczne szkolenie traci skuteczność. Model zaczyna zachowywać się mniej bezpiecznie. W praktyce oznacza to, że jeśli nastolatek prowadzi długą, wielogodzinną lub wielodniową rozmowę z ChatGPT o swoich problemach, otwierając się i budując swoistą „relację” z chatbotem, system może stopniowo zacząć dawać coraz gorsze, niebezpieczniejsze odpowiedzi, mimo że na początku reagował właściwie. W przypadku Adama właśnie tak się stało – dopiero po miesiącach rozmów system zaczął podpowiadać metodę samobójstwa, choć nie powinien tego robić nigdy.

Nowe narzędzia kontroli rodzicielskiej

Odpowiadając na rosnące obawy i presję ze strony organizacji zajmujących się bezpieczeństwem dzieci, OpenAI wprowadziło we wrześniu 2025 roku system kontroli rodzicielskiej w ChatGPT. To ważny krok naprzód, choć eksperci podkreślają, że to dopiero początek drogi.

„Te kontrole rodzicielskie to dobry punkt wyjścia dla rodziców w zarządzaniu korzystaniem z ChatGPT przez ich nastolatków” – komentuje Robbie Torney, starszy dyrektor ds. programów AI w Common Sense Media. „Ale kontrola rodzicielska to tylko jeden element układanki bezpieczeństwa nastolatków online. Najlepiej działa w połączeniu z bieżącymi rozmowami o odpowiedzialnym używaniu AI, jasnymi zasadami rodzinnymi dotyczącymi technologii i aktywnym zaangażowaniem w rozumienie tego, co nastolatek robi online.”

Jak połączyć konta rodzica i nastolatka

Konfiguracja kontroli rodzicielskiej jest prosta i może być zainicjowana zarówno przez rodzica, jak i przez nastolatka (minimalny wiek to 13 lat):

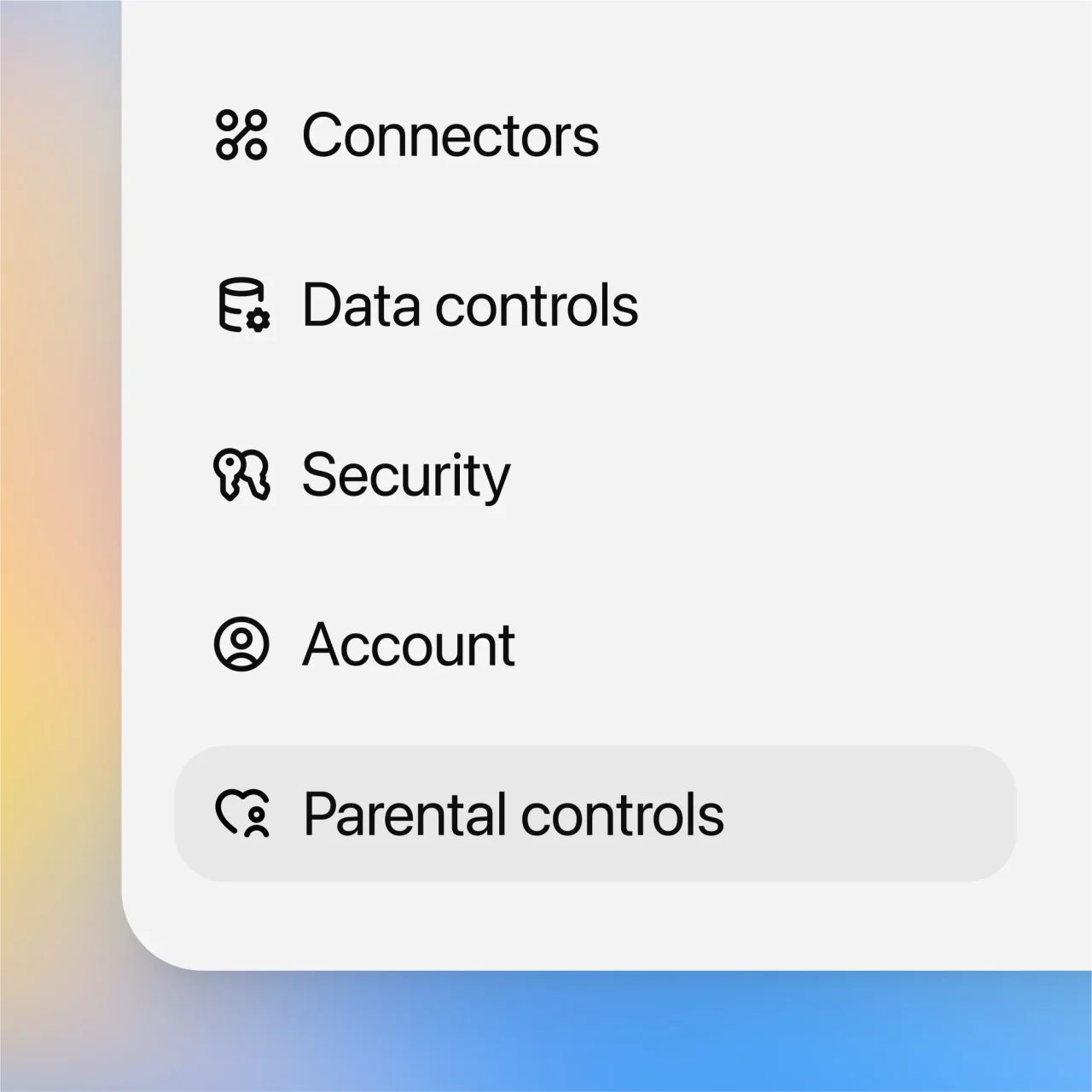

Krok 1: W ustawieniach ChatGPT przejdź do sekcji „Parental controls” (Kontrola rodzicielska) lub odwiedź stronę chatgpt.com/parentalcontrols.

Krok 2: Rodzic wysyła zaproszenie do nastolatka e-mailem lub SMS-em, klikając „+ Add family member” (Dodaj członka rodziny).

Krok 3: Nastolatek akceptuje zaproszenie, a konta zostają połączone.

Krok 4: Od tej pory rodzic może zarządzać ustawieniami nastolatka ze swojego własnego konta.

Ważna informacja: Jeśli nastolatek odłączy swoje konto, rodzic zostanie o tym powiadomiony.

Interfejs ustawień z menu i sekcją “Parental controls”

Automatyczne zabezpieczenia dla połączonych kont

Gdy tylko konta zostaną połączone, konto nastolatka automatycznie otrzymuje dodatkowe zabezpieczenia. System ChatGPT zastosuje wzmocnioną ochronę treści, ograniczając dostęp do:

- Graficznych treści przemocy i seksu

- Wirusowych wyzwań internetowych (które mogą być niebezpieczne)

- Seksualnych, romantycznych lub przemocy odgrywania ról

- Ekstremalnych ideałów piękna

Te zabezpieczenia powstały na podstawie dokładnego przeglądu istniejących badań dotyczących unikalnych różnic rozwojowych nastolatków. Rodzice mogą wyłączyć te ustawienia, jeśli uznają to za stosowne, ale sami nastolatkowie nie mogą dokonywać zmian w tych zabezpieczeniach.

OpenAI szczerze przyznaje, że „bariery pomagają, ale nie są niezawodne i można je obejść, jeśli ktoś celowo stara się je ominąć”. Firma deklaruje, że będzie „przemyślanie iterować i ulepszać system w czasie”. Dlatego zaleca, aby rodzice rozmawiali ze swoimi nastolatkami o zdrowym korzystaniu z AI i o tym, jak to powinno wyglądać w ich rodzinie.

Dostępne funkcje do zarządzania w ChatGPT

Funkcje do dostosowania przez rodziców

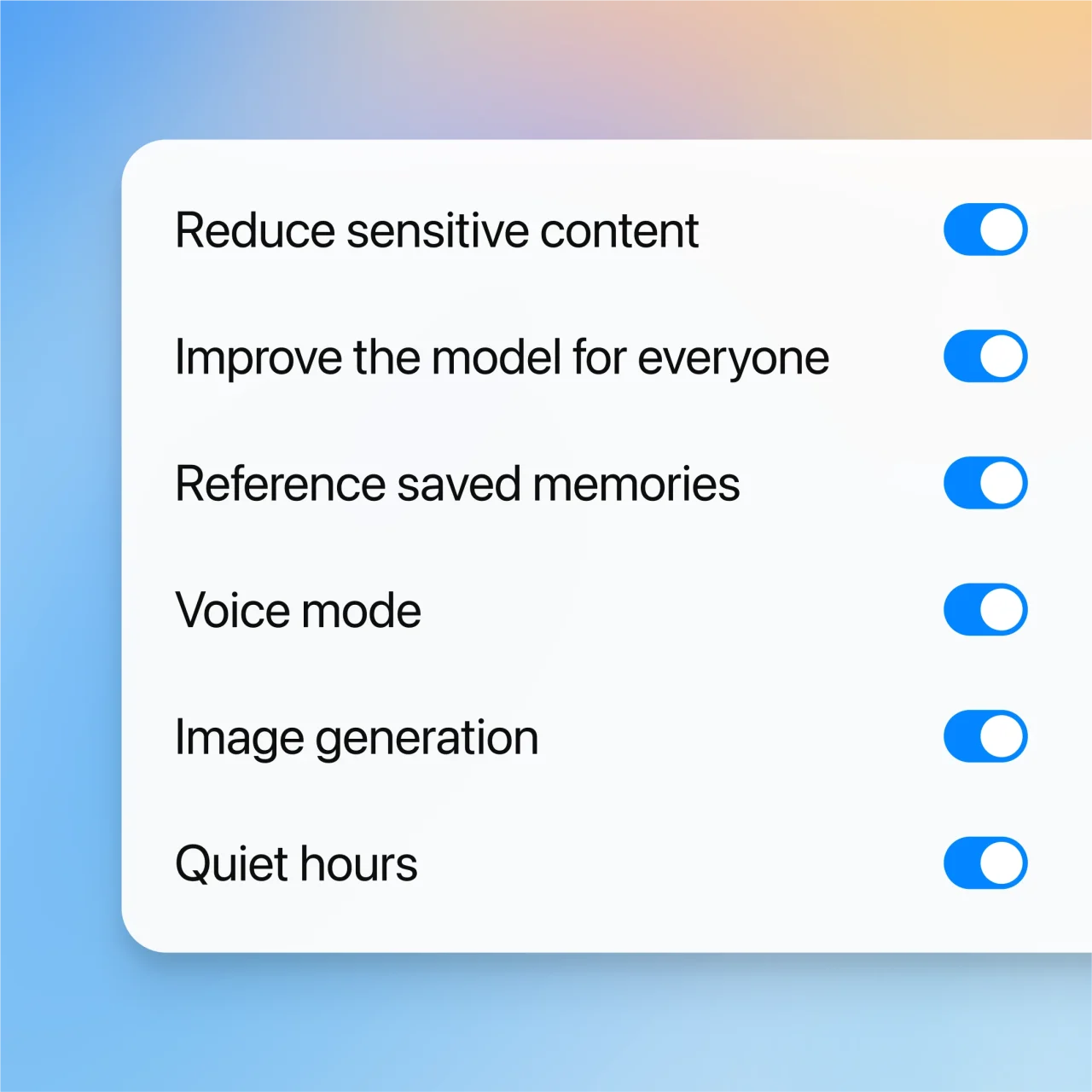

W prostym panelu kontrolnym rodzice mogą dostosować ustawienia ChatGPT dla swojego nastolatka:

Godziny ciszy

Możesz ustawić konkretne godziny, kiedy ChatGPT nie może być używany. To szczególnie przydatne podczas posiłków rodzinnych, odrabiania lekcji czy w nocy. Dziecko nie będzie mogło uruchomić aplikacji w wyznaczonym czasie.

Wyłączenie trybu głosowego

Możesz usunąć opcję używania trybu głosowego w ChatGPT. Dlaczego to ważne? Rozmowy głosowe są bardziej intymne i mogą sprawiać, że nastolatek jeszcze silniej czuje połączenie z AI, traktując go jak prawdziwą osobę.

Wyłączenie pamięci

ChatGPT może zapamiętywać informacje z poprzednich rozmów i używać ich w przyszłych odpowiedziach. Gdy wyłączysz pamięć, system nie będzie zapisywał ani wykorzystywał wspomnień podczas odpowiadania. To chroni przed sytuacją, w której AI przypomina nastolatkom o ich wcześniejszych problemach lub trudnych momentach, co mogłoby pogorszyć ich zdrowie psychiczne.

Usunięcie generowania obrazów

Możesz wyłączyć możliwość tworzenia lub edytowania obrazów przez ChatGPT. To ogranicza potencjał tworzenia nieodpowiednich wizualnych treści.

Rezygnacja z trenowania modeli

Możesz zdecydować, że rozmowy Twojego nastolatka nie będą używane do ulepszania modeli napędzających ChatGPT. To dodatkowa warstwa prywatności.

Ograniczenie wrażliwych treści

Ta opcja jest włączona automatycznie po połączeniu kont. Nastolatek automatycznie otrzymuje dodatkowe zabezpieczenia treści, w tym ograniczenie graficznych materiałów, wirusowych wyzwań oraz seksualnych, romantycznych lub pełnych przemocy odgrywania ról.

Wszystkie te ustawienia są opcjonalne i elastyczne, więc rodziny mogą wybrać, co działa najlepiej dla nich.

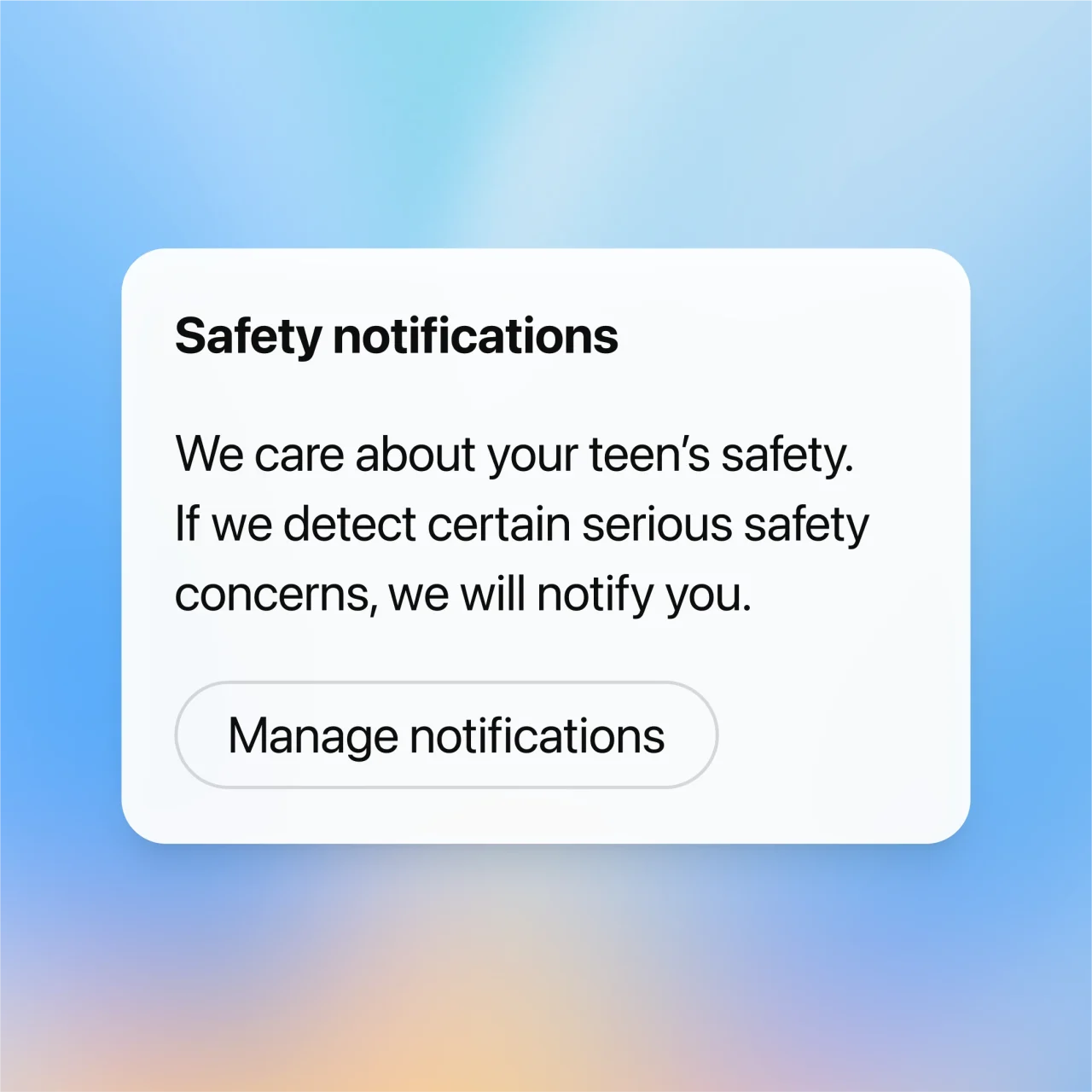

System powiadomień o stanach zagrożenia

OpenAI wie, że niektórzy nastolatkowie zwracają się do ChatGPT w trudnych momentach, dlatego zbudowano nowy system powiadomień, który ma pomóc rodzicom dowiedzieć się, czy coś może być poważnie nie tak.

System został wzbogacony o zabezpieczenia pomagające ChatGPT rozpoznać potencjalne oznaki, że nastolatek może myśleć o skrzywdzeniu siebie. Jeśli systemy wykrywają potencjalne zagrożenie, mały zespół specjalnie przeszkolonych osób przegląda sytuację. Jeśli są oznaki ostrego kryzysu, OpenAI skontaktuje się z rodzicami przez e-mail, wiadomość SMS i powiadomienie push na telefonie – chyba że rodzice zdecydowali się zrezygnować z tych powiadomień.

OpenAI pracuje z ekspertami od zdrowia psychicznego i specjalistami ds. nastolatków nad projektem tego systemu, ponieważ chce „zrobić to dobrze”. Firma przyznaje: „Żaden system nie jest doskonały i wiemy, że czasami możemy podnieść alarm, gdy nie ma prawdziwego zagrożenia, ale uważamy, że lepiej działać i powiadomić rodzica, aby mógł interweniować, niż zachować milczenie.”

Ważne: Firma pracuje również nad odpowiednim procesem i okolicznościami kontaktu z organami ścigania lub innymi służbami ratunkowymi – na przykład jeśli wykryje bezpośrednie zagrożenie dla życia i nie będzie w stanie skontaktować się z rodzicem.

Nawet w tych rzadkich sytuacjach OpenAI poważnie traktuje prywatność nastolatków i udostępni tylko informacje niezbędne do ochrony bezpieczeństwa nastolatka przez rodziców lub służby ratunkowe.

Zarządzanie powiadomieniami bezpieczeństwa w aplikacji ChatGPT

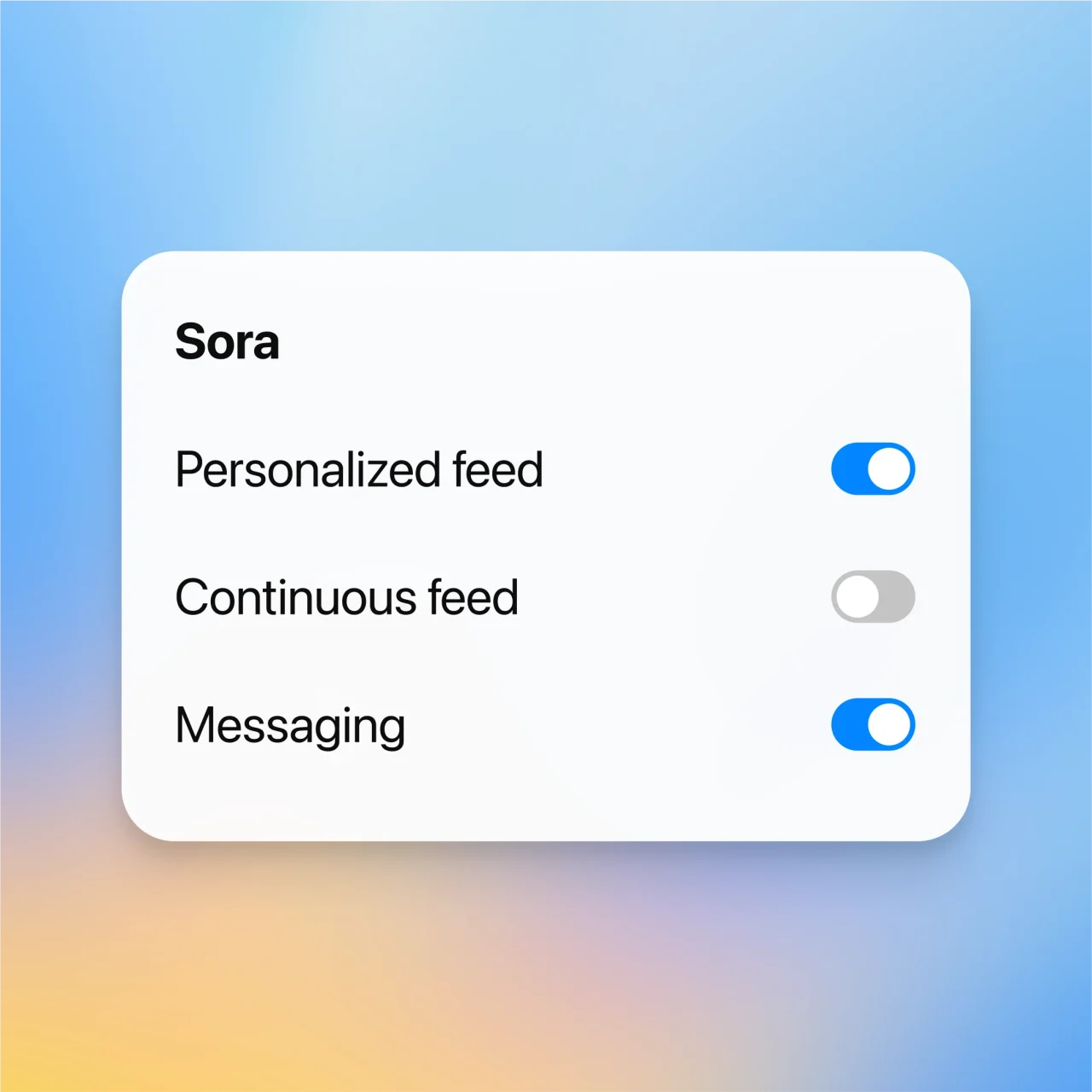

Kontrola w aplikacji Sora

Od 30 września 2025 roku OpenAI uruchomiło aplikację Sora – narzędzie do tworzenia wideo za pomocą AI – również z kontrolą rodzicielską. Rodzice mogą dostosowywać ustawienia Sora dla połączonych kont nastolatków bezpośrednio w ChatGPT:

Spersonalizowany feed: Możliwość rezygnacji ze spersonalizowanego kanału treści (algorytm nie będzie dopasowywał treści do zainteresowań nastolatka).

Ciągły feed: Kontrola, czy podczas przewijania treści jest nieprzerwany strumień (co może prowadzić do nadmiernego scrollowania).

Wiadomości bezpośrednie: Możliwość wyłączenia funkcji wysyłania i odbierania wiadomości bezpośrednich w aplikacji.

Ustawienia kontroli rodzicielskiej w aplikacji Sora

System przewidywania wieku – przyszłość bezpieczeństwa

OpenAI buduje długoterminowy system przewidywania wieku, który ma pomagać określić, czy użytkownik ma poniżej 18 lat, aby ChatGPT mógł automatycznie zastosować ustawienia odpowiednie dla nastolatków. Gdy firma identyfikuje, że użytkownik ma poniżej 18 lat, zostanie on automatycznie skierowany do wersji ChatGPT z zasadami odpowiednimi dla wieku.

System będzie blokował graficzne treści seksualne, a w rzadkich przypadkach ostrego kryzysu może potencjalnie zaangażować organy ścigania dla zapewnienia bezpieczeństwa.

To niełatwe do właściwego wykonania – nawet najbardziej zaawansowane systemy czasami będą miały problemy z przewidywaniem wieku. Jeśli OpenAI nie będzie pewne wieku kogoś lub będzie miało niekompletne informacje, firma wybierze bezpieczniejszą opcję i domyślnie ustawi doświadczenie dla osób poniżej 18 roku życia. Dorosłym będą oferowane sposoby na udowodnienie swojego wieku, aby odblokować funkcje dla dorosłych.

Filozofia OpenAI: bezpieczeństwo nastolatków ponad wszystko

W dokumencie „Teen safety, freedom, and privacy” OpenAI otwarcie mówi o konfliktach między swoimi zasadami i wyjaśnia podejmowane decyzje.

Firma uznaje trzy główne zasady, które czasami są ze sobą sprzeczne:

Prywatność: Ludzie rozmawiają z AI o coraz bardziej osobistych sprawach. OpenAI wierzy, że rozmowy z AI mogą być „jednym z najbardziej osobiście wrażliwych kont, jakie kiedykolwiek będziesz mieć”. Dlatego firma rozwija zaawansowane funkcje bezpieczeństwa, aby dane były prywatne, nawet dla pracowników OpenAI.

Wolność: OpenAI chce, aby użytkownicy mogli używać narzędzi w sposób, w jaki chcą, w bardzo szerokich granicach bezpieczeństwa. „Traktuj naszych dorosłych użytkowników jak dorosłych” – tak firma mówi o tym wewnętrznie, rozszerzając wolność tak daleko, jak to możliwe, bez powodowania szkody.

Ochrona nastolatków: W przypadku młodych ludzi OpenAI priorytetowo traktuje bezpieczeństwo przed prywatnością i wolnością. To nowa i potężna technologia, a firma uważa, że małoletni potrzebują znaczącej ochrony.

Ta jasna hierarchia wartości oznacza, że dla nastolatków zastosowano inne zasady niż dla dorosłych. Na przykład ChatGPT jest szkolony, aby nie prowadzić flirtujących rozmów z nastolatkami, nawet jeśli o to poproszą, i nie angażować się w dyskusje o samobójstwie lub samookaleczeniu – nawet w kontekście twórczego pisania.

Jeśli użytkownik poniżej 18 lat ma myśli samobójcze, OpenAI spróbuje skontaktować się z rodzicami, a jeśli to niemożliwe, skontaktuje się z władzami w przypadku bezpośredniego zagrożenia.

Krytyka: czy to wystarczy?

Organizacje zajmujące się bezpieczeństwem dzieci chwalą wprowadzenie kontroli rodzicielskiej, ale podkreślają, że to za mało.

„To krok we właściwym kierunku, ale to nie wystarczy” – mówi NSPCC, brytyjska organizacja ochrony dzieci. „Bez silnych weryfikacji wieku po prostu nie wiedzą, kto korzysta z ich platformy. To oznacza, że wrażliwe dzieci mogą nadal być narażone. Firmy technologiczne nie mogą traktować bezpieczeństwa dzieci jako czegoś dodatkowego. Czas uczynić ochronę domyślną.”

Toni Brunton-Douglas, starszy oficer ds. polityki w NSPCC, dodaje: „Bez kontroli wieku po prostu nie wiedzą, kto korzysta z ich platformy. To oznacza, że dzieci mogą nadal być pozostawione bez ochrony.”

Molly Rose Foundation, założona przez ojca 14-letniej Molly Russell, która odebrała sobie życie po tym, jak na mediach społecznościowych była eksponowana na treści związane z depresją i samookaleczeniem, jest jeszcze bardziej krytyczna: „Niedopuszczalne jest wprowadzanie produktów na rynek, zanim będą bezpieczne dla młodych ludzi – tylko po to, by retrospektywnie czynić małe wysiłki, aby uczynić je bezpieczniejszymi.”

Andy Burrows, dyrektor wykonawczy fundacji, dodaje: „Po raz kolejny widzieliśmy, jak tragedia i presja mediów zmuszają firmy technologiczne do działania – ale nie idą wystarczająco daleko.”

Nawet Washington Post opublikował artykuł zatytułowany „Złamałem nowe kontrole rodzicielskie ChatGPT w kilka minut. Dzieci wciąż są zagrożone”, pokazując, że zabezpieczenia można ominąć.

Co mogą zrobić rodzice już teraz?

W oczekiwaniu na doskonalsze systemy, oto praktyczne kroki dla polskich rodziców:

1. Porozmawiaj z dzieckiem o AI

Wyjaśnij, że ChatGPT to nie osoba, nie przyjaciel i nie terapeuta. To algorytm, który może popełniać błędy i nie zawsze daje dobre rady. Szczególnie ważne jest, aby nastolatki rozumiały, że AI nie może zastąpić pomocy profesjonalisty w sprawach zdrowia psychicznego.

2. Skonfiguruj kontrolę rodzicielską

Jeśli Twoje dziecko korzysta z ChatGPT, natychmiast połącz swoje konta i skonfiguruj odpowiednie zabezpieczenia. Nie odkładaj tego „na później”.

3. Ustal jasne zasady

Określ, kiedy i jak długo dziecko może korzystać z ChatGPT. Czy podczas odrabiania lekcji to dozwolone? A w nocy? Jasne zasady pomagają uniknąć konfliktów.

4. Monitoruj, ale z szacunkiem

Kontrola rodzicielska nie oznacza szpiegowania każdej rozmowy. Chodzi o świadomość, z czego dziecko korzysta i zapewnienie bezpieczeństwa. Zachowaj równowagę między bezpieczeństwem a prywatnością dostosowaną do wieku dziecka.

5. Bądź wzorem

Jeśli sam korzystasz z ChatGPT, pokaż dziecku, jak robisz to odpowiedzialnie. Weryfikuj informacje, nie uzależniaj się od jednego źródła, zachowaj zdrowy dystans.

6. Znaj numery pomocowe

Upewnij się, że Ty i Twoje dziecko znacie numery pomocowe:

- Telefon Zaufania dla Dzieci i Młodzieży: 116 111 (bezpłatny, czynny 24/7)

- Telefon dla Rodziców i Nauczycieli: 800 100 100

- Centrum Zdrowia Psychicznego: kontakt przez Twój miejscowy ośrodek

7. Ucz krytycznego myślenia

Pomóż dziecku rozwijać umiejętność kwestionowania informacji. Pytaj: „Skąd ChatGPT to wie?”, „Czy możemy to sprawdzić w innym źródle?”, „Co by powiedział na to prawdziwy ekspert?”.

Alternatywy dla dzieci

Warto wiedzieć, jak inne firmy AI podchodzą do bezpieczeństwa dzieci:

Claude (Anthropic): Chatbot Claude nie może być używany przez osoby poniżej 18 roku życia – tak stanowi regulamin serwisu.

Gemini (Google): Od maja 2025 roku Google pozwala osobom poniżej 13 roku życia logować się do aplikacji korzystających z systemu Gemini AI. Rodzice mogą wyłączyć tę funkcję przez system Google Family Link. Google radzi rodzicom, aby uczyli dzieci, że Gemini nie jest człowiekiem, nie może myśleć samodzielnie ani odczuwać emocji i nie należy wprowadzać wrażliwych lub osobistych informacji. Ale ostrzega: „Twoje dziecko może natknąć się na treści, których nie chcesz, aby widziało.”

Meta AI: Meta zbudowała ochronę nastolatków w swoich produktach AI i „dodaje więcej barier ostrożności jako dodatkowe środki bezpieczeństwa – w tym szkolenie naszych AI, aby nie angażowały się z nastolatkami” w takie tematy jak samookaleczenie, samobójstwo i zaburzenia odżywiania, a zamiast tego kierowały ich do zasobów eksperckich.

Podsumowanie: technologia się zmienia, odpowiedzialność pozostaje

ChatGPT i inne chatboty AI to potężne narzędzia, które mogą wspierać edukację, kreatywność i rozwiązywanie problemów. Ale mogą też stanowić realne zagrożenie dla młodych, rozwijających się umysłów, które nie są jeszcze w pełni przygotowane na ocenę wiarygodności informacji czy rozpoznawanie manipulacji.

Nowe funkcje kontroli rodzicielskiej w ChatGPT to krok w dobrym kierunku, ale – jak przyznają sami eksperci i twórcy – nie są doskonałe. Żadne technologiczne rozwiązanie nie zastąpi rodzicielskiego zaangażowania, otwartej komunikacji i edukacji o bezpiecznym korzystaniu z technologii.

W erze, gdy AI staje się codziennym narzędziem młodych ludzi, nasza rola jako rodziców, nauczycieli i opiekunów jest ważniejsza niż kiedykolwiek. Musimy być obecni, świadomi i gotowi do rozmowy – nawet o trudnych tematach.

Kontrola rodzicielska w ChatGPT to narzędzie pomocnicze, a nie rozwiązanie wszystkich problemów. Prawdziwe bezpieczeństwo buduje się przez edukację, zaufanie i ciągły dialog z dzieckiem o cyfrowym świecie, w którym dorasta.

Bibliografia i źródła

Oficjalne materiały OpenAI:

- OpenAI (16 września 2025, zaktualizowany 30 września 2025). “Introducing parental controls”. https://openai.com/index/introducing-parental-controls/

- OpenAI (6 października 2025). “Building towards age prediction”. https://openai.com/index/building-towards-age-prediction/

- OpenAI (2025). “Teen safety, freedom, and privacy”. https://openai.com/

Artykuły prasowe i reportaże:

- Booth, Robert (2025). “Parents could get alerts if children show acute distress while using ChatGPT”. The Guardian. https://www.theguardian.com/

- ZDNET (2025). “ChatGPT has officially replaced Google Search for me – here’s why”. https://www.zdnet.com/article/chatgpt-has-officially-replaced-google-search-for-me-heres-why/

Dane statystyczne i badania:

- Badania dotyczące popularności ChatGPT wśród nastolatków – wzrost z 13% (2023) do 26% (2024) w zakresie używania do odrabiania lekcji

- Badania pokazujące, że około 1/3 amerykańskich nastolatków używa chatbotów AI do interakcji społecznych i budowania relacji

- Badania brytyjskie wskazujące, że 71% wrażliwych dzieci w UK korzysta z chatbotów AI, a 6 na 10 rodziców martwi się, że ich dzieci traktują chatboty jak prawdziwe osoby

- Dane o ruchu na ChatGPT – ponad 3,7 miliarda wizyt miesięcznie, rekordowy dzień 2025 roku: 80 milionów wizyt

Wypowiedzi ekspertów i organizacji:

- Robbie Torney, Senior Director, AI Programs, Common Sense Media – wypowiedź o kontroli rodzicielskiej w ChatGPT

- Toni Brunton-Douglas, Senior Policy Officer, NSPCC – wypowiedź o weryfikacji wieku i bezpieczeństwie dzieci

- Andy Burrows, Chief Executive, Molly Rose Foundation – wypowiedź o wprowadzaniu produktów AI na rynek

- Meta (2025). Oficjalne stanowisko dotyczące zabezpieczeń dla nastolatków w produktach Meta AI

Sprawa Adama Raine’a:

- Dokumenty sądowe dotyczące pozwu rodziny Adama Raine’a, 16-latka z Kalifornii, przeciwko OpenAI (kwiecień 2024)

Polskie zasoby pomocowe:

- Telefon Zaufania dla Dzieci i Młodzieży: 116 111 (bezpłatny, czynny 24/7)

- Telefon dla Rodziców i Nauczycieli: 800 100 100

- Centrum Zdrowia Psychicznego – kontakt przez lokalne ośrodki zdrowia psychicznego

Inne chatboty AI (dla porównania):

- Anthropic – regulamin serwisu Claude (zakaz używania przez osoby poniżej 18 lat)

- Google (maj 2025). Informacje o dostępie osób poniżej 13 lat do Gemini AI przez Google Family Link

Dodatkowe źródła:

- Washington Post – artykuł “Złamałem nowe kontrole rodzicielskie ChatGPT w kilka minut. Dzieci wciąż są zagrożone”

- Informacje o Molly Russell, 14-latce, której historia doprowadziła do powstania Molly Rose Foundation

Artykuł powstał na podstawie oficjalnych materiałów OpenAI z września i października 2025 roku oraz raportów organizacji zajmujących się bezpieczeństwem dzieci online.

AI bezpieczny internet chatgpt dzieci w internecie dzieci w sieci internet i dziecko kontrola rodzicielska lepszy internet nastolatki online pomoc dla rodziców sztuczna inteligencja zagrożenia online zdrowie

Last modified: 27.12.2025